Die Grenze des Unbekannten bezeichnet nicht bloß eine Abwesenheit von Wissen, sondern ein dynamisches Spannungsfeld zwischen dem, was gegenwärtig erklärt oder beschrieben werden kann, und dem, was sich der vorliegenden Methodik, den vorhandenen Daten oder den begrifflichen Voraussetzungen entzieht. Sie manifestiert sich sowohl als epistemische Grenze — also in den Limitationen unserer Erkenntnistheorien und Messinstrumente — als auch als pragmatische Grenze, die durch institutionelle Prioritäten, ökonomische Ressourcen und kulturelle Normen geformt wird. Verstehen heißt hier, diese Multidimensionalität zu erkennen: Unbekanntheit ist keine einfache Leere, sondern ein Geflecht von Ursachen, Effekten und möglichen Übergängen in Bekanntes.

Man kann das unbekannte Feld in verschiedene Kategorien differenzieren, um seine Struktur besser erfassen zu können:

- Bekannte Unbekannte: Fragen oder Variablen, deren Existenz erkannt ist, deren genaue Werte oder Beziehungen jedoch unklar bleiben.

- Unbekannte Unbekannte: Phänomene, deren Existenz oder Relevanz noch nicht antizipiert wurde und die erst durch Beobachtung oder kreatives Denken emergieren.

- Unkenntnis als prinzipielle Unmöglichkeit: Bereiche, in denen aufgrund theoretischer Begründungen (z. B. formale Grenzen wie Gödel-artige Resultate oder physikalische Unschärfen) vollständiges Wissen unerreichbar ist.

Mehrere Faktoren erzeugen und verfestigen diese Grenze. Zu den technischen Limitationen zählen Auflösungsvermögen, Sensitivität und Genauigkeit messender Geräte sowie infrastrukturelle Beschränkungen in Datensammlung und -speicherung. Kognitive und methodische Beschränkungen beinhalten Wahrnehmungsgrenzen, Heuristiken und falsch angenommene Kausalitäten, die Wissenschaftlerinnen und Gesellschaften in ihren Fragestellungen leiten. Schließlich wirken soziale Faktoren: Finanzierungsströme, publizistische Aufmerksamkeit, Bildungsstrukturen und Machtverhältnisse bestimmen, welche Unbekannten bearbeitet und welche vernachlässigt werden.

Die Grenze ist nicht statisch; sie verschiebt sich durch technologische Innovation, methodische Weiterentwicklung und Paradigmenwechsel. Neue Instrumente — von leistungsfähigen Teleskopen über Sequenziermaschinen bis zu KI-gestützten Algorithmen — transformieren Teile des Unbekannten in überprüfbare Hypothesen. Gleichwohl entstehen oft gleichzeitig neue Rätsel auf höheren Komplexitätsebenen: je feiner die Messung, desto mehr Muster erscheinen, deren Erklärung neue Modelle verlangt. Das bedeutet, dass das Fortschreiten der Erkenntnis häufig eher die Struktur des Unbekannten reorganisiert als es vollständig eliminiert.

Komplexität und Emergenz tragen dazu bei, dass manche Bereiche praktisch oder sogar prinzipiell schwer zugänglich bleiben. Wechselwirkungen in nichtlinearen Systemen, Pfadabhängigkeiten und multikausale Vernetzungen führen dazu, dass Vorhersagen unsicher bleiben, auch wenn zugrundeliegende Prozesse teilweise verstanden sind. In solchen Kontexten verschiebt sich die Fragestellung: Statt nach deterministischen Gesetzen wird nach Wahrscheinlichkeiten, Robustheitskriterien und Bedingungen für Stabilität und Wandel gefragt.

Sprache, Modellbildung und Ontologie beeinflussen, was wir als unbekannt wahrnehmen. Begriffe und Kategorien strukturieren die Beobachtung; sie machen bestimmte Fragestellungen prägnant und andere unsichtbar. Modellgrenzen — die Annahmen, die ein Modell bewusst ausschließt — erzeugen also systematisch blinde Flecken. Das Reflexionsvermögen der Disziplinen, die Bereitschaft, Annahmen offen zu legen und alternative Perspektiven einzubeziehen, ist deshalb zentral, um die Grenze des Unbekannten produktiv handhabbar zu machen.

Schließlich ist die Wahrnehmung der Grenze auch kulturell und historisch bedingt: Gesellschaftliche Prioritäten definieren, welche Fragen als bedeutend gelten und welche Unsicherheiten toleriert werden. Was in einer Epoche als unentrinnbar unbekannt galt, kann in einer anderen aufgrund veränderter Werte, Interessen oder Technologien in den Bereich des Erforschbaren vordringen. Dies impliziert, dass das Verstehen der Grenze des Unbekannten immer auch eine Analyse der sozialen Rahmenbedingungen erfordert, in denen Erkenntnis produziert wird.

Methoden zur erforschung des unbekannten

Die Erforschung des Unbekannten verlangt kein singuläres Werkzeug, sondern ein Bündel komplementärer Methoden, die je nach Fragestellung und Kontext in unterschiedlichen Kombinationen eingesetzt werden. Ein grundlegendes Prinzip ist die rekursive Wechselwirkung zwischen Beobachtung, Modellbildung und Intervention: Beobachtungen liefern Daten, Modelle ordnen und erklären diese Daten, und gezielte Interventionen testen die Vorhersagen der Modelle. Diese Schleife wird durch stufenweises Verfeinern—von groben Hypothesen zu präziseren Modellen—getragen und ermöglicht, Bereiche des Unbekannten systematisch zu verkleinern oder neu zu kartieren.

Methoden lassen sich grob in beobachtende und experimentelle Zugänge unterscheiden. Beobachtende Verfahren, etwa Langzeitmessungen in der Astrophysik oder ethnografische Felderhebungen in den Sozialwissenschaften, sind geeignet, Phänomene in natürlicher Umgebung zu dokumentieren und unerwartete Muster zu entdecken. Experimentelle Ansätze hingegen erzeugen kontrollierte Bedingungen, um Kausalzusammenhänge zu prüfen. Beide Zugänge haben Grenzen: Beobachtungen sind oft von Konfoundern durchzogen, Experimente sind in komplexen Systemen nicht immer vollständig übertragbar auf natürliche Systeme.

Unterscheidungen in der forschungslogischen Herangehensweise sind ebenfalls zentral: Hypothesengetriebene Forschung zielt auf die Prüfung klar formulierter Vorhersagen; explorative Forschung sucht Muster ohne vorab festgelegte Hypothesen. Explorative Methoden profitieren heute besonders von datengetriebenen Techniken—maschinellem Lernen, Cluster-Analysen, Dimensionsreduktion—die Strukturen in großen, heterogenen Datensätzen sichtbar machen können. Diese Verfahren erzeugen Vorschläge für erklärende Modelle, die anschließend hypothesengeleitet überprüft werden sollten, um Überanpassung und Trivialisierung zu vermeiden.

Computersimulationen und modellbasierte Ansätze sind unverzichtbar, wenn direkte Experimente unpraktisch oder unethisch sind. Agentenbasierte Modelle, Differentialgleichungssysteme, Monte-Carlo-Simulationen und digitale Zwillinge erlauben das Durchspielen von Szenarien, Sensitivitätsanalysen und das Studium emergenter Effekte. Dabei ist die Validierung zentral: Simulationsresultate müssen gegen beobachtbare Daten kalibriert und die Grenzen der Modellannahmen transparent gemacht werden, damit aus virtuellen Experimenten belastbare Schlussfolgerungen entstehen.

Mess- und Instrumentierungsstrategien bestimmen oft, welche Unbekannten überhaupt adressierbar sind. Fortschritte in Sensorik, Bildgebung, Sequenzierung oder Radar- und Satellitentechnik haben wiederholt ganze Forschungsfelder erschlossen. Parallel dazu gewinnen adaptive Messstrategien an Bedeutung: Sensor-Netzwerke, modulare Probenahme und adaptive Sampling-Protokolle erhöhen die Effizienz, indem sie Messkapazitäten dorthin lenken, wo die Unsicherheit am größten ist.

Statistik und Unsicherheitsquantifizierung sind nicht Nebenwerkzeuge, sondern integraler Bestandteil des Methodenrepertoires. Bayesianische Methoden erlauben explizite Einbettung von Vorwissen und iteratives Lernen, Frequentistische Verfahren liefern robuste Teststatistiken, und Ensemble-Methoden kombinieren verschiedene Modelle, um strukturelle Unsicherheit abzubilden. Sensitivitätsanalysen, Monte-Carlo-Fehlerfortpflanzung und Konfidenzintervalle machen sichtbar, wie verlässlich gemachte Aussagen tatsächlich sind.

Adaptive Versuchspläne und sequenzielle Designs reagieren dynamisch auf interimistische Ergebnisse: In klinischen Studien, A/B-Tests oder Materialprüfungen kann der Versuchsverlauf anhand neuer Evidenz angepasst werden, um Ressourcen zu sparen und schneller zu robusten Erkenntnissen zu gelangen. Ähnlich nutzt Active Learning in maschinellen Systemen gezielte Datenauswahl, um mit minimalem Aufwand maximale Informationsgewinne zu erzielen.

Interdisziplinäre Triangulation erhöht die Robustheit bei der Erforschung des Unbekannten, weil unterschiedliche Fachtraditionen verschiedene Blindheiten und Biases kompensieren können. Kombinationen aus quantitativen und qualitativen Methoden, Modellierung und Feldevidenz oder experimenteller und historischer Analyse schaffen konsiliente Evidenzketten, die einzelne methodische Schwächen abfedern.

Partizipative Ansätze—Citizen Science, Community-basierte Forschungsmethoden und kollaborative Plattformen—erweitern nicht nur die Datengrundlage, sondern bringen auch neue Perspektiven und erst mögliche Fragestellungen ein. Diese Methoden erfordern jedoch sorgfältige Protokolle zur Qualitätskontrolle, Nachverfolgbarkeit und Datenbereinigung, damit breite Teilnahme nicht auf Kosten wissenschaftlicher Verlässlichkeit geht.

Methodologische Reflexivität ist ein weiteres sehr praktisches Instrument: Die systematische Prüfung der eigenen Annahmen, die Offenlegung von Modellgrenzen und die Durchführung von Robustheitschecks vermindern die Gefahr, dass methodische Gewohnheiten die Beobachtung dominieren. Formalisierte Praktiken wie Pre-Registration, Replikationsstudien und offene Datensätze stärken die Reproduzierbarkeit und machen Forschungsmethoden selbst zum Gegenstand methodischer Untersuchung.

Serendipität und Kreativität spielen eine unterschätzte Rolle. Offene Explorationsräume—etwa interdisziplinäre Labore, Explorationsfonds oder flexible Forschungszeit—fördern das Entstehen unvorhergesehener Beobachtungen. Strukturierte Fördermechanismen für risikoreiche, potenziell höchstertragreiche Projekte erhöhen die Chance, völlig neue Felder zu erschließen, die in streng hypothesengeleiteten Programmen nicht auftauchen würden.

Schließlich ist die Infrastruktur für Datenmanagement, Rechenleistung und Kooperation entscheidend für methodischen Erfolg. Skalierbare Recheninfrastrukturen, standardisierte Metadaten, interoperable Datenformate und langfristige Archive ermöglichen die kumulative Nutzung von Erkenntnissen und das Wiederholen von Analysen. Ohne diese technischen und organisatorischen Voraussetzungen bleiben viele methodische Innovationen fragmentarisch und schwer übertragbar.

Ethische folgen und gesellschaftliche perspektiven

Die Erforschung des Unbekannten wirft nicht nur epistemische Fragen auf, sondern produziert unmittelbar normative Spannungen: Welche Risiken sind vertretbar, wer trägt die Folgen, und nach welchen Kriterien werden Entscheidungen getroffen, wenn Unsicherheit groß ist? Diese Fragen betreffen Wissenschaftlerinnen und Wissenschaftler ebenso wie Politik, Wirtschaft und die Zivilgesellschaft. Ethik in diesem Kontext bedeutet deshalb nicht nur abstrakte Reflexion, sondern konkrete Ordnungs- und Gestaltungsaufgaben für Forschungspraxis, Regulation und Öffentlichkeitsarbeit.

Ein zentrales ethisches Problem ergibt sich aus der Asymmetrie zwischen Wissen und Macht. Institutionen oder Akteurinnen, die technischen Zugang, Finanzmittel oder Datenkontrollen besitzen, bestimmen oft, welche Unbekannten adressiert werden und welche verborgen bleiben. Das hat Folgen für Gerechtigkeit und Teilhabe: Wenn Forschungsergebnisse patentierbar oder kommerzialisierbar sind, können die Erträge privatisiert werden, während Risiken und negative Externalitäten öffentlich verbleiben. Die Frage, wer von der Transformation des Unbekannten in Know-how profitiert, ist deshalb stets auch eine Frage der Verteilungsgerechtigkeit.

Ein weiterer ethischer Kernpunkt sind Risiken und deren Management unter tiefgreifender Unsicherheit. Klassische Risikobewertung stößt an Grenzen, wenn Wahrscheinlichkeiten kaum quantifizierbar sind oder wenn emergente Systemeffekte möglich sind. In solchen Fällen konkurrieren normative Orientierungen: das Vorsorgeprinzip, das im Zweifel Einschränkungen fordert, und ein proaktionaler Ansatz, der Innovationen nicht durch vorauseilende Verbote ersticken will. Verantwortungsvolle Entscheidungsfindung muss diese Spannungen transparent machen und Mechanismen anbieten, die iterative Anpassung erlauben.

Die Forschung an potenziell dual-use-technologien — etwa synthetische Biologie, bestimmte KI-Anwendungen oder neue Materialverfahren — verlangt spezielle ethische Aufmerksamkeit. Dual-use bedeutet, dass die gleichen Erkenntnisse sowohl für wohltätige als auch für schädliche Zwecke genutzt werden können. Praktische Maßnahmen umfassen Zugangsbeschränkungen, gestufte Veröffentlichungspolitiken, Ethik- und Sicherheits-Reviews sowie Ausbildungsprogramme, die Sensibilisierung für Missbrauchsrisiken verankern.

Datenschutz, Privatsphäre und informierte Zustimmung sind weitere Felder, in denen die Grenze des Unbekannten ethische Herausforderungen erzeugt. Big Data und algorithmische Methoden ermöglichen Einsichten in Verhaltensmuster, die Einzelne oder Gruppen gefährden können, wenn sie missbraucht werden. Es ist daher notwendig, Prinzipien wie Datenminimierung, Zweckbindung und Rechenschaftspflicht in Forschungsdesigns zu verankern und Betroffene in Entscheidungen einzubeziehen, wenn ihre Daten zu neuen Erkenntnissen beitragen sollen.

- Transparenz: Offenlegung von Methoden, Datenquellen, Unsicherheiten und Interessenkonflikten.

- Partizipation: Einbeziehung betroffener Gemeinschaften in Fragestellung, Design und Bewertung von Forschungsvorhaben.

- Gerechtigkeit: Mechanismen zur fairen Verteilung von Nutzen und Risiken, inklusive Maßnahmen gegen exklusive Patentsperren.

- Vorsorge: Festlegung von Schwellen, ab denen präventive Maßnahmen oder Nutzungseinschränkungen greifen.

Gesellschaftliche Perspektiven auf das Unbekannte sind zudem kulturell geprägt: Verschiedene Gesellschaften haben unterschiedliche Toleranzen gegenüber Risiko, unterschiedliche Vorstellungen von Autonomie und kollektiver Verantwortung. Diese Divergenzen spielen eine Rolle in internationalen Forschungskooperationen und in der globalen Governance. Wer globale Standards setzt, muss deshalb nicht nur technisches Fachwissen, sondern auch kulturelle Sensitivität und legitime Beteiligungsformate berücksichtigen.

Bildung und Wissenschaftskommunikation sind zentrale Hebel, um gesellschaftliche Verantwortung zu stärken. Eine informierte Öffentlichkeit kann besser zwischen überzogenem Alarmismus und unkritischer Technikgläubigkeit unterscheiden. Wissenschaftskommunikation sollte Unsicherheiten offenlegen und zugänglich machen, ohne die Komplexität zu verniedlichen, und Debattenräume fördern, in denen normative, epistemische und praktische Aspekte verknüpft werden.

Institutionell lassen sich mehrere Instrumente identifizieren, die ethische Folgen und gesellschaftliche Perspektiven operationalisieren: Ethikbeiräte mit diverser Zusammensetzung, verbindliche Impact-Assessments vor Förderentscheidungen, adaptive Regulierung mit Prüfzeiträumen und Sunset-Klauseln, sowie Mechanismen zur Rechenschaft, die auch nach Projektabschluss wirksam bleiben. Solche Instrumente sollten darauf abzielen, Verantwortlichkeiten klar zu definieren und Handlungsoptionen in Situationen hoher Unsicherheit auf transparente Weise zu koordinieren.

Auf der Ebene der Forschungspraxis bedeutet verantwortliches Handeln konkret: Ethik bereits in den Entwurfsprozess integrieren (ethics-by-design), fortlaufende Risikoüberwachung etablieren, und flexible Governance-Strukturen schaffen, die bei neuen Erkenntnissen oder unerwarteten Folgen rasche Anpassungen erlauben. Interdisziplinäre Teams, die neben naturwissenschaftlicher auch sozialwissenschaftliche und geisteswissenschaftliche Expertise einschließen, erhöhen die Fähigkeit, normative Implikationen frühzeitig zu erkennen und adäquat zu adressieren.

Schließlich verlangt eine verantwortungsvolle Gesellschaftspolitik, dass politische Entscheidungsprozesse Mechanismen für anticipatory governance einbauen: Szenariobasierte Vorausschau, partizipative Zukunftswerkstätten, Monitoring-Indikatoren für emergente Risiken und internationale Kooperationsplattformen. Nur durch solche strukturierten Voraussichten lässt sich vermeiden, dass die Entdeckung neuer Wissensräume zu unkontrollierten sozialen Verwerfungen oder zu asymmetrischer Machtausübung führt.

–

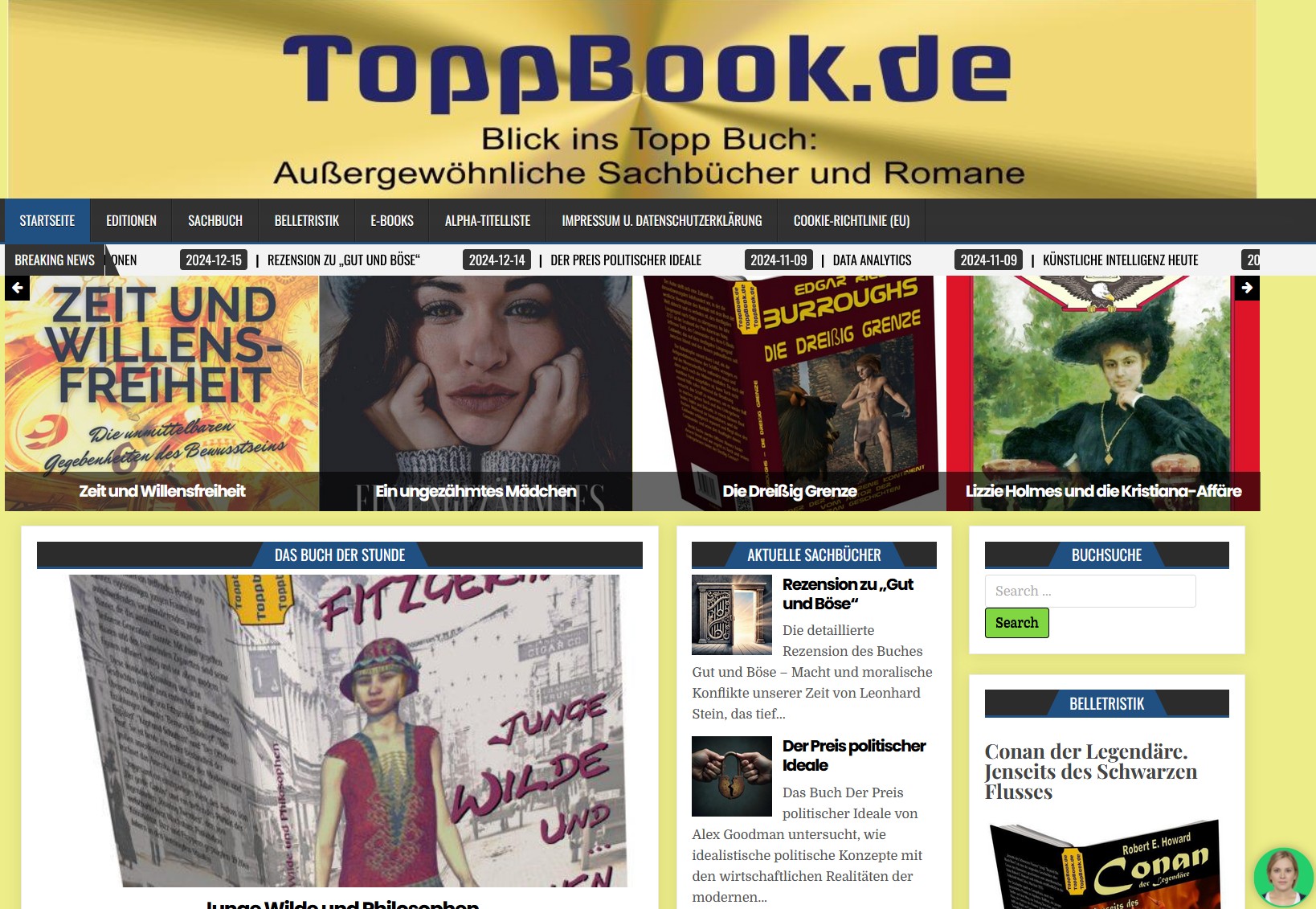

Jetzt suchen und reinlesen auf toppbook.de

und ins Buch eintauchen

Der Blogbeitrag verdeutlicht eindrucksvoll, wie wichtig es ist, die Grenzen des Wissens zu erkennen und zu hinterfragen. Innovation entsteht oft jenseits dieser Grenzen – ein spannendes Abenteuer für jeden Unternehmer!

Ah, das Unbekannte! So viel komplexer als der simpelste Keks. Wer hätte gedacht, dass es so viele Arten von Unkenntnis gibt? Vielleicht sollten wir einfach die Grenzen des Wissens mit einem Stift nachziehen! 🖊️✨

Ein spannender Blick auf die Grenzen des Wissens! Es ist faszinierend, wie viele Dimensionen das Unbekannte hat und welche Rolle soziale Faktoren dabei spielen. Ein echtes Abenteuer des Entdeckens!