Wissenschaftliches Erkenntnisstreben beruht auf einer Palette klar strukturierter Methoden, die systematisch beobachtete Phänomene in überprüfbares Wissen überführen. Zentrale Elemente sind sorgfältige Beobachtung, präzise Messung, das Bilden testbarer Hypothesen sowie wiederholbare Experimente und Messreihen. Diese Schritte werden begleitet von statistischen Auswertungen, Fehlerabschätzungen und der kritischen Reflexion der Annahmen, die jeden Schluss begründen.

Die Vielfalt der methodischen Zugänge spiegelt die unterschiedlichen Fragestellungen der Physik wider: Während manche Probleme durch idealisierte Modelle und analytische Rechnungen vorangetrieben werden, erfordern andere hochpräzise Messtechnik, große Datensätze oder komplexe numerische Simulationen. Methoden sind dabei keine starren Rezepturen, sondern folgen pragmatischen Kriterien wie Robustheit, Reproduzierbarkeit und der Fähigkeit, Vorhersagen zu liefern, die sich empirisch falsifizieren lassen.

- Beobachtung und Messung: Systematische Datenerhebung ist die Grundlage. Dabei sind Auflösung, Sensitivität, Kalibrierung und das Verständnis von Messunsicherheiten entscheidend. Messdaten werden häufig vorverarbeitet, gefiltert und auf systematische Fehler geprüft, bevor sie in Hypothesen einfließen.

- Experimentelles Design: Kontrollierte Experimente erlauben das gezielte Variieren einzelner Größen, um Ursache-Wirkungs-Beziehungen zu identifizieren. Wichtige Prinzipien sind Kontrolle von Störgrößen, Randomisierung, Wiederholbarkeit und die Festlegung klarer Beobachtungsprotokolle.

- Induktion und Deduktion: Induktive Verfahren dienen dem Erkennen von Mustern und Gesetzmäßigkeiten aus Daten, deduktive Methoden prüfen daraus abgeleitete Vorhersagen. Beide Vorgehensweisen ergänzen sich: induktive Einsichten liefern Hypothesen, deduktive Tests prüfen deren Gültigkeit.

- Modellbildung: Mathematische Modelle abstrahieren physikalische Systeme und ermöglichen quantitative Aussagen. Modellvalidierung erfolgt durch Vergleich mit Messdaten und Sensitivitätsanalysen hinsichtlich Parameter und Modellannahmen.

- Numerische Simulation und Informatik: Simulationen ergänzen Methoden, wenn analytische Lösungen fehlen. Numerische Stabilität, Konvergenz, Diskretisierungsfehler und algorithmische Komplexität sind dabei zentrale Qualitätskriterien.

- Statistische Inferenz: Wahrscheinlichkeitstheoretische Methoden und Bayessche Ansätze quantifizieren Evidenz, erlauben Hypothesentests und bauen Konfidenz- bzw. Glaubwürdigkeitsintervalle für Parameter auf. Statistische Modellwahl verhindert Überanpassung und fördert die Generalisierbarkeit.

- Vergleichende und historische Methoden: Vergleich von unterschiedlichen Systemen, Replikationsstudien und historische Analysen etablierter Theorien helfen, die Reichweite und Grenzen methodischer Schlussfolgerungen zu erkennen.

- Gedankenexperimente und konzeptionelle Analysen: Intuitionsfördernde und logisch scharfe Überlegungen klären Konzepte, zeigen Grenzfälle auf und inspirieren experimentelle Tests, insbesondere wenn direkte Experimente technisch schwierig sind.

Ein konsistenter methodischer Workflow umfasst die präzise Dokumentation aller Schritte, offene Datenpraktiken und die Verfügbarkeit von Analyseprotokollen, damit Ergebnisse unabhängig geprüft und reproduziert werden können. Fehleranalysen – inklusive systematischer und statistischer Unsicherheiten sowie möglicher Bias-Quellen – sind integraler Bestandteil jeder Aussage über physikalische Größen.

Die zunehmende Verfügbarkeit großer Datenmengen und leistungsfähiger Rechenressourcen hat neue methodische Werkzeuge hervorgebracht: Machine Learning und datengetriebene Modellbildung können Muster aufdecken, die klassische Ansätze übersehen, müssen aber sorgfältig gegen Überanpassung, Interpretationsfehler und mangelnde Physik-Konsistenz abgesichert werden. Hybride Methoden, die physikalische Gesetzmäßigkeiten mit datenbasierten Ansätzen verbinden, gewinnen deshalb an Bedeutung.

Methodenentwicklung ist auch ein soziales und technisches Unterfangen: Instrumentenbau, Standardisierung von Messprotokollen, interdisziplinäre Kooperationen und Ausbildung sind Voraussetzungen dafür, dass methodische Fortschritte zu robusten Erkenntnissen führen. Kritische Reflexion der Annahmen, transparente Berichterstattung und die Bereitschaft zur Replikation stärken die Vertrauenswürdigkeit der gewonnenen Erkenntnisse.

Modelle und theoriebildung

Modelle sind die Schnittstelle zwischen beobachteten Phänomenen und abstrakten Theorien: Sie verdichten Beobachtungen zu strukturierten Darstellungen, in denen Annahmen, Freiheitsgrade und relevante Terme explizit gemacht werden. Ein Modell ist nie die Wirklichkeit selbst, sondern ein Werkzeug zur Organisation von Wissen, zur Formulierung präziser Vorhersagen und zur Generierung neuer Fragen. Die Kunst der Modellbildung besteht darin, das richtige Maß an Vereinfachung zu finden — so einfach wie möglich, aber nicht so einfach, dass zentrale Effekte verloren gehen.

- Phänomenologische Modelle: Beschreiben Beobachtungen unmittelbar durch relationsbasierte Formeln ohne tiefere Mechanismen anzugeben (z. B. empirische Fitfunktionen).

- Mechanistische und dynamische Modelle: Versuchen, zugrundeliegende Prozesse zu beschreiben, häufig durch Differentialgleichungen oder mechanistische Regeln.

- Effektive Theorien: Gültig in einem begrenzten Energiebereich oder Skalenbereich; sie fassen komplexe Mikrophysik in wenigen relevanten Parametern zusammen.

- Statistische und probabilistische Modelle: Repräsentieren Unsicherheit und Variabilität, etwa durch stochastische Differentialgleichungen oder Bayessche Netze.

- Computational/Simulative Modelle: Diskrete oder diskretisierte Darstellungen, die numerische Experimente erlauben, wenn analytische Lösungen fehlen.

- Toy-Modelle und Grenzfälle: Vereinfachte Konstrukte, die Intuition schärfen und Kernmechanismen isolieren.

Jedes dieser Modelltypen bringt spezifische Vor- und Nachteile mit sich. Phänomenologische Modelle sind oft schnell an Daten anpassbar, liefern aber nur begrenzte Einsichten in Ursachen. Mechanistische Modelle bieten Erklärungstiefe, stehen jedoch vor Herausforderungen wie Parametrisierbarkeit, numerischer Stabilität oder fehlender Messbarkeit mancher innerer Größen. Effektive Theorien erklären, warum unterschiedliche mikroskopische Details auf makroskopischer Ebene gleiches Verhalten erzeugen können — ein Schlüsselkonzept für Multiskalenprobleme.

Idealisationen und Approximationen sind unvermeidbar: Vernachlässigte Kräfte, gerundete Geometrien oder linearisierte Gleichungen schaffen Modelltraktabilität. Entscheidend ist, diese Annahmen explizit zu machen und ihre Konsequenzen durch Sensitivitätsanalysen und Fehlerabschätzungen zu quantifizieren. Solche Analysen zeigen, ob Schlussfolgerungen robust gegenüber Unsicherheiten in Parametern oder Modellstruktur sind.

Die Validierung von Modellen folgt einem zyklischen Prozess: Formulierung, Kalibrierung an Daten, Validierung durch unabhängige Tests, Revision oder Erweiterung. Parameterbestimmung, Identifizierbarkeitsprüfung und Unsicherheitsquantifizierung sind dabei zentral. Statistische Methoden — Maximum-Likelihood, Bayessche Inferenz, Kreuzvalidierung — helfen, Überanpassung zu vermeiden und die Aussagekraft von Modellen realistisch einzuschätzen.

- Empirische Adäquanz: Wie gut erklärt das Modell die vorhandenen Daten?

- Vorhersagekraft: Liefert das Modell neue, prüfbare Vorhersagen?

- Sparsamkeit (Occam): Verzichtet das Modell auf unnötige Komplexität?

- Sichtweite/Anwendbarkeit: Auf welche Skalen und Phänomene lässt sich das Modell übertragen?

- Innere Konsistenz: Frei von logischen Widersprüchen und mathematischen Singularitäten?

- Fruchtbarkeit: Führt es zu neuen Konzepten, Experimenten oder Technologien?

Mathematische Strukturen spielen eine doppelte Rolle: Sie sind sowohl Werkzeuge zur Formulierung von Modellen als auch Quellen von Einsicht. Symmetrieprinzipien, Erhaltungssätze und Variationsprinzipien reduzieren die Anzahl freier Parameter und liefern Leitlinien für Modellkonstruktion. Die Entdeckung einer zugrunde liegenden Symmetrie kann bestehende Modelle vereinfachen oder neue Verallgemeinerungen erzwingen.

Beziehungen zwischen Theorien — Reduktion, Emergenz und Multiple Realizability — sind praktisch relevant. Manche Phänomene lassen sich erfolgreich aus fundamentalen Gesetzen ableiten, andere zeigen emergentes Verhalten, das auf höheren Ebenen effizienter beschrieben wird. Renormierungs- und Skalenargumente rechtfertigen oft die Verwendung effektiver Theorien und erklären, warum Details der Mikrodynamik auf makroskopischer Ebene irrelevant werden.

Theoriebildung ist zudem ein kreativer und historisch kontingenter Prozess. Anomalien gegenüber etablierten Modellen können zu graduellen Anpassungen führen oder, falls sie tief genug sind, einen Paradigmenwechsel nach sich ziehen. Theorieentwicklung beruht auf mathematischer Strenge, empirischer Konfrontation und heuristischen Leitmotiven — Intuition, Analogien und ästhetische Kriterien wie Einfachheit und Eleganz haben empirische Bedeutung, weil sie oft zu fruchtbaren, weiter prüfbaren Modellen führen.

In der Praxis bedeutet dies: Theorie und Experiment sind in einem dynamischen Austausch verbunden. Theorien geben Versuchsanordnungen, Messgrößen und kritische Tests vor; Experimente liefern Daten, die Modelle einschränken, falsifizieren oder verfeinern. Offenheit in Modellannahmen, Reproduzierbarkeit von Auswertungen und die Bereitstellung von Code und Daten ermöglichen eine kollektive, prüfbare Theoriebildung, die über individuelle Deutungen hinaus Bestand haben kann.

Experimentelle praxis und ethik

Gute experimentelle Praxis verbindet technische Präzision mit organisatorischer Sorgfalt: Ein durchdachtes Versuchsdesign, klare Festlegung der Messgrößen und eine vollständige Fehlerrechnung bilden die Grundlage jeder belastbaren Aussage. Messprotokolle müssen reproduzierbar sein, Kalibrierungen dokumentiert und Messunsicherheiten quantitativ bewertet werden. Blindanalysen oder unabhängige Replikationsmessungen reduzieren unbewusste Verzerrungen, während Sensitivitätsanalysen aufzeigen, welche Annahmen und Parameter die Schlussfolgerungen am stärksten beeinflussen.

Im täglichen Laborbetrieb sind standardisierte Arbeitsanweisungen (SOPs), regelmäßige Wartung von Geräten und sorgfältige Kalibrierprotokolle unabdingbar. Instrumente sollten mit nachvollziehbaren Serien- und Kalibrierungsdaten betrieben werden; Messreihen sind so anzulegen, dass systematische Effekte identifiziert und minimiert werden können. Qualitativ hochwertige Messtechnik allein reicht nicht: die Kompetenz und Fortbildung der experimentellen Teams ist ein zentrales Qualitätsmerkmal — Mentoring, Trainingsmodule und Fehlerkultur fördern korrekte Anwendung und kritische Reflexion.

Transparente Daten- und Codeverwaltung ist Teil der experimentellen Verantwortung. Rohdaten, Verarbeitungs- und Analyse-Skripte sowie Metadaten sollten langfristig archiviert und unter geeigneten Lizenzen zugänglich gemacht werden. Prinzipien wie FAIR (findable, accessible, interoperable, reusable) erleichtern Nachprüfbarkeit und sekundäre Auswertungen; Versionskontrolle und dokumentierte Reproduktionsanleitungen helfen, Analysepfade nachvollziehbar zu halten.

- Dokumentation: Vollständige Protokolle, Datenschemata und Kalibrierungsaufzeichnungen.

- Versionierung: Nutzung von Repositorien und Version-Control-Systemen für Code und Daten.

- Metadaten: Beschreibung von Messbedingungen, Umgebungsgrößen und Gerätekonfigurationen.

- Langzeitarchivierung: Sicherung von Rohdaten und Analyseskripten in stabilen Formaten.

Ethik im experimentellen Kontext reicht über korrekte Buchführung hinaus und umfasst integrative Fragen von Forschungsethik, Verantwortung gegenüber Mitarbeitenden und der Öffentlichkeit sowie Folgenabschätzungen für Umwelt und Gesellschaft. Integrität bedeutet neben der Vermeidung offenkundiger Fälschungen auch den offenen Umgang mit Unsicherheiten, das Melden von Fehlern und die Bereitschaft, fehlerhafte Ergebnisse zu korrigieren. Autoren- und Mitautorenschaft sollen transparent und fair vergeben werden; Ghost- oder Gift-Authorship untergräbt Vertrauen und Verantwortungsketten.

Besondere Sorgfalt erfordert der Umgang mit potenziellen Dual-Use-Anwendungen: Techniken, die sowohl zivile als auch missbräuchliche Verwendungsmöglichkeiten haben könnten, verlangen Risikobewusstsein, Abstimmungsprozesse mit Ethikkommissionen und gegebenenfalls Beschränkungen beim Datenzugang. Ebenso sind Umweltaspekte zu berücksichtigen — von Energiebedarf großer Messanlagen bis zur Entsorgung gefährlicher Materialien — und in Projektplanungen als Kosten- und Risikofaktor zu behandeln.

- Verantwortungstransparenz: Offenlegung von Finanzierungsquellen und möglichen Interessenkonflikten.

- Risikomanagement: Abschätzung und Kommunikation von Risiken, Sicherheitsplänen und Notfallprotokollen.

- Umweltbewusstsein: Bewertung von Energieverbrauch, Materialeinsatz und Abfallmanagement.

- Dual-Use-Vorsorge: Prüfung möglicher missbräuchlicher Anwendungen und angemessene Schutzmaßnahmen.

Forschungsethik wird institutionell durch Regularien, Genehmigungsverfahren und Compliance-Strukturen unterstützt. Für Experimente mit besonderen Gefährdungen — ionisierende Strahlung, Hochspannung, Cryotechnik, starke Magnetfelder oder biologische Komponenten — gelten klare rechtliche und normative Vorgaben, die über bloßes technisches Können hinausgehen. Die Einhaltung dieser Vorgaben schützt Mitarbeitende und Außenstehende und stärkt die gesellschaftliche Legitimation wissenschaftlicher Vorhaben.

Gerechtigkeit und Chancengleichheit sind im experimentellen Betrieb ebenso relevant: Zugang zu großen Forschungsinfrastrukturen, Verteilung von Messzeiten und Anerkennung in Großprojekten sollten nach klaren, sachbezogenen Kriterien erfolgen, um eine faire Teilhabe an wissenschaftlichen Ressourcen zu gewährleisten. In internationalen Kollaborationen erfordern unterschiedliche regulatorische Rahmenbedingungen zusätzliches Management und transparente Governance-Strukturen.

Publikations- und Kommunikationspraktiken bilden die Brücke zur Öffentlichkeit. Übertrieben vereinfachte oder sensationalisierte Darstellungen können Vertrauen untergraben; gleichzeitig ist verständliche Vermittlung nötig, um die Relevanz und Grenzen experimenteller Ergebnisse zu erklären. Open-Science-Initiativen, Preprint-Veröffentlichungen und offene Peer-Review-Prozesse fördern schnelle, aber auch verantwortungsvolle Wissensverbreitung. Negative Ergebnisse und Replikationen sollten anerkannt und publizierbar bleiben, um Publikationsbias zu verringern.

Schließlich ist die Förderung einer konstruktiven Fehlerkultur zentral: Institutionelle Mechanismen zum anonymen Melden von Missständen, klare Abläufe für Untersuchungen möglicher Fehlverhalten und angemessene, transparente Sanktionen stärken das Vertrauensverhältnis innerhalb der Forschungsgemeinschaft und gegenüber der Gesellschaft. Prävention durch Ausbildung, klare Regeln und offene Kommunikation ist langfristig wirksamer als reaktive Maßnahmen.

–

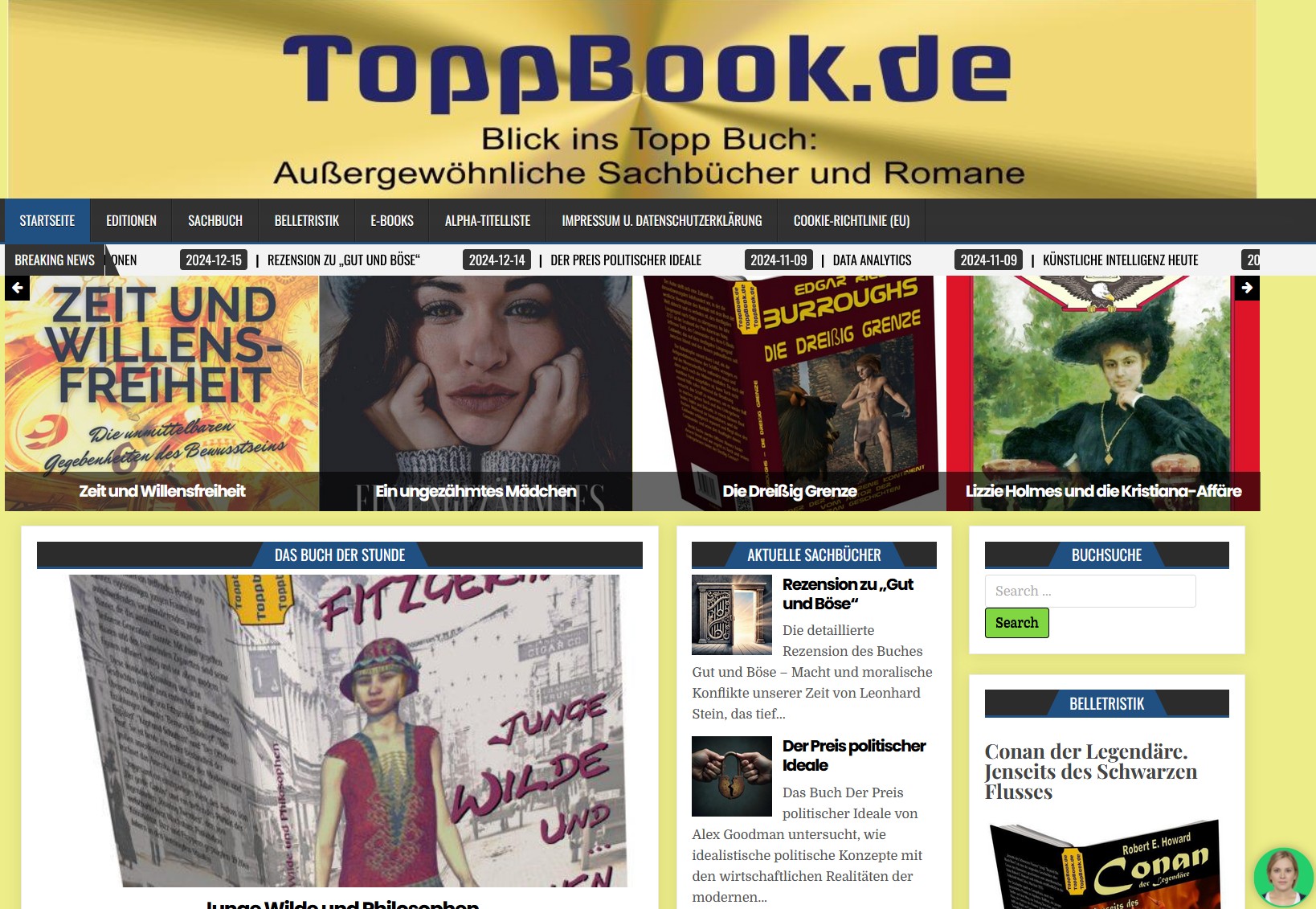

Jetzt suchen und reinlesen auf toppbook.de

und ins Buch eintauchen

Ein toller Beitrag, der die Essenz wissenschaftlicher Methoden prägnant zusammenfasst! Die Verbindung von Theorie und Experiment wird hier klar hervorgehoben. Robustheit und Transparenz sind essenziell für vertrauenswürdige Erkenntnisse.

Toller Beitrag! Die detaillierte Erklärung der wissenschaftlichen Methoden ist super wichtig. Die Verknüpfung von Datenanalyse und Theorie ist entscheidend für unseren Wissensdurst. Weiter so! 🌟🔍

Wissenschaft muss transparent, reproduzierbar und ethisch sein! Die Methoden sind der Schlüssel zur Wahrheit, und jeder Schritt zählt. Lasst uns für integrative und verantwortungsvolle Forschung eintreten!